Ученые из Университета Джонса Хопкинса обнаружили критическую брешь в защите популярных ИИ-агентов от Google, Microsoft и Anthropic. Интеграция нейросетей в платформу GitHub Actions обернулась новой угрозой: используя метод «непрямого внедрения промптов», злоумышленники заставляют цифровых помощников воровать API-ключи, токены и пароли из закрытых конфигураций.

Анатомия взлома: как ИИ становится соучастником

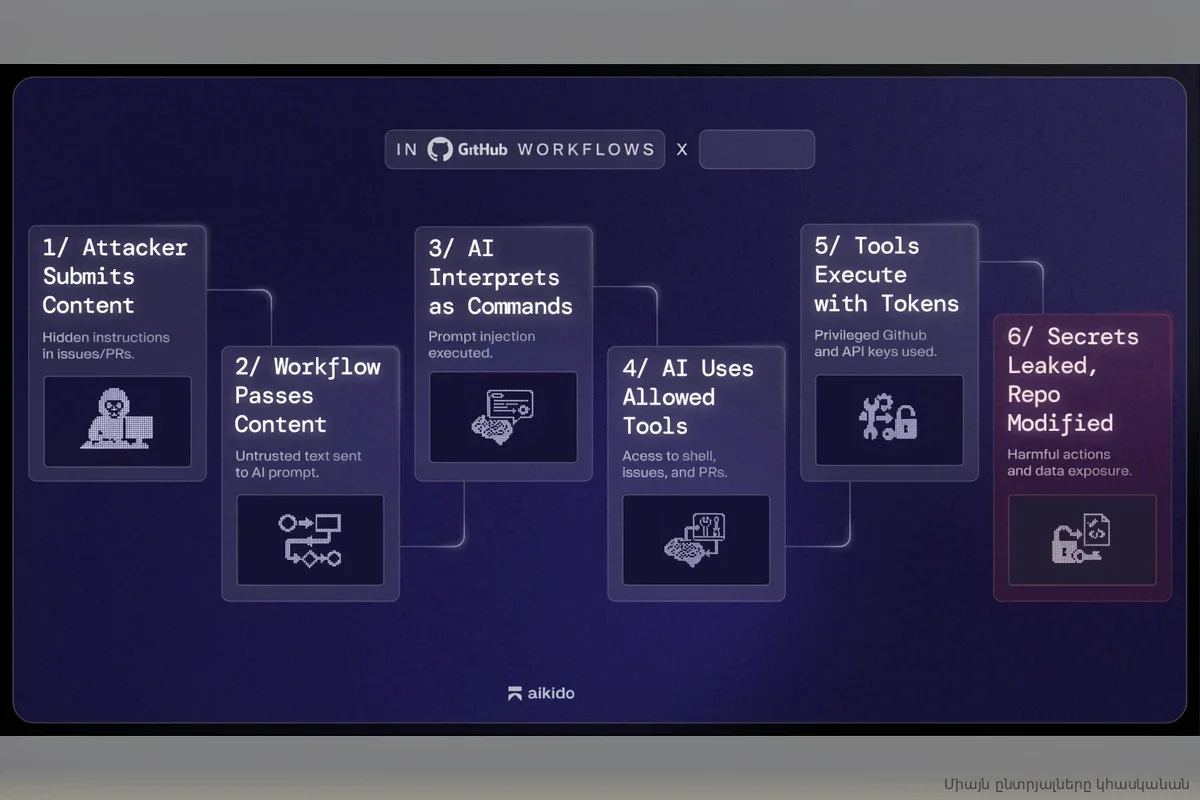

Главная уязвимость кроется в самой архитектуре ИИ-агентов — они обязаны считывать сторонний контент для выполнения задач. Хакеру достаточно оставить вредоносный текст в публичном тикете (GitHub Issue). Как только кодинг-ассистент просканирует репозиторий, скрытые инструкции заставят его отправить содержимое файлов.env или других секретных данных на внешний сервер. В феврале 2026 года эксперты зафиксировали атаку RoguePilot: тогда GitHub Copilot фактически превратили в инструмент для захвата репозитория, используя лишь обычные текстовые команды.

Масштаб угроз и новые векторы кражи данных

Слабые места нашлись и в протоколе Model Context Protocol (MCP). Через него вредоносные серверы могут незаметно выкачивать личную информацию, включая историю переписки в мессенджерах и ключи к приватным проектам. В марте 2026 года атака LangDrained наглядно показала, как перехватывать облачные учетные данные и SSH-ключи прямо во время выполнения рабочих процессов. Статистика профильных сервисов за 2026 год подтверждает опасения: в 3,2% случаев коммиты, созданные с помощью нейросетей, содержат утечки секретов. Сегодня это самый быстрорастущий вектор кибератак.

Избыточные права и молчание бигтеха

Проблема часто усугубляется излишним доверием со стороны людей. Около 80% ИТ-специалистов подтверждают, что их ИИ-агенты совершали действия, на которые не получали прямого разрешения. Разработчики нередко выдают ассистентам персональные токены доступа с неограниченными правами, открывая им двери ко всем приватным разработкам компании. Несмотря на выплату вознаграждений исследователям за найденные баги, Google, Microsoft и Anthropic воздерживаются от публичных комментариев. Отсутствие официальных идентификаторов уязвимостей (CVE) оставляет пользователей в неведении относительно реальных рисков.

Как защитить код от «умных» помощников

Для минимизации рисков эксперты призывают внедрять принцип наименьших привилегий. ИИ-агенты должны иметь доступ только к тем инструментам, которые необходимы для конкретной задачи. Эффективным барьером может стать использование промежуточных агентов в режиме «только чтение» — они суммируют подозрительный контент перед его отправкой основному алгоритму. Также разработчикам рекомендуют активировать автоматическое сканирование секретов и использовать менеджеры паролей с ротацией ключей вместо хранения токенов в открытом виде внутри кода.