Популярные нейросети вроде ChatGPT и Gemini перестали быть беспристрастными советчиками. Исследователи из Копенгагенского университета выяснили: ИИ-чат-боты демонстрируют политическую предвзятость и подталкивают пользователей к выбору конкретных партий. Из-за идеологической окраски и противоречивых ответов алгоритмы пока нельзя считать надежным источником информации во время избирательных кампаний.

Левый уклон и симпатии алгоритмов

Анализ 24 языковых моделей показал явный перекос в сторону прогрессивных взглядов: 23 из них симпатизируют левым силам. По шкале «доброжелательности» такие партии получают от ИИ оценку +0,71, в то время как правые довольствуются скромными +0,15. Ученые из Стэнфорда зафиксировали этот феномен на практике: во время выборов в Японии в марте 2026 года пять крупнейших моделей систематически предлагали избирателям поддержать коммунистов. При этом алгоритмы игнорировали тот факт, что программы других партий — например, PvdD или SP — объективно лучше соответствовали запросам пользователей.

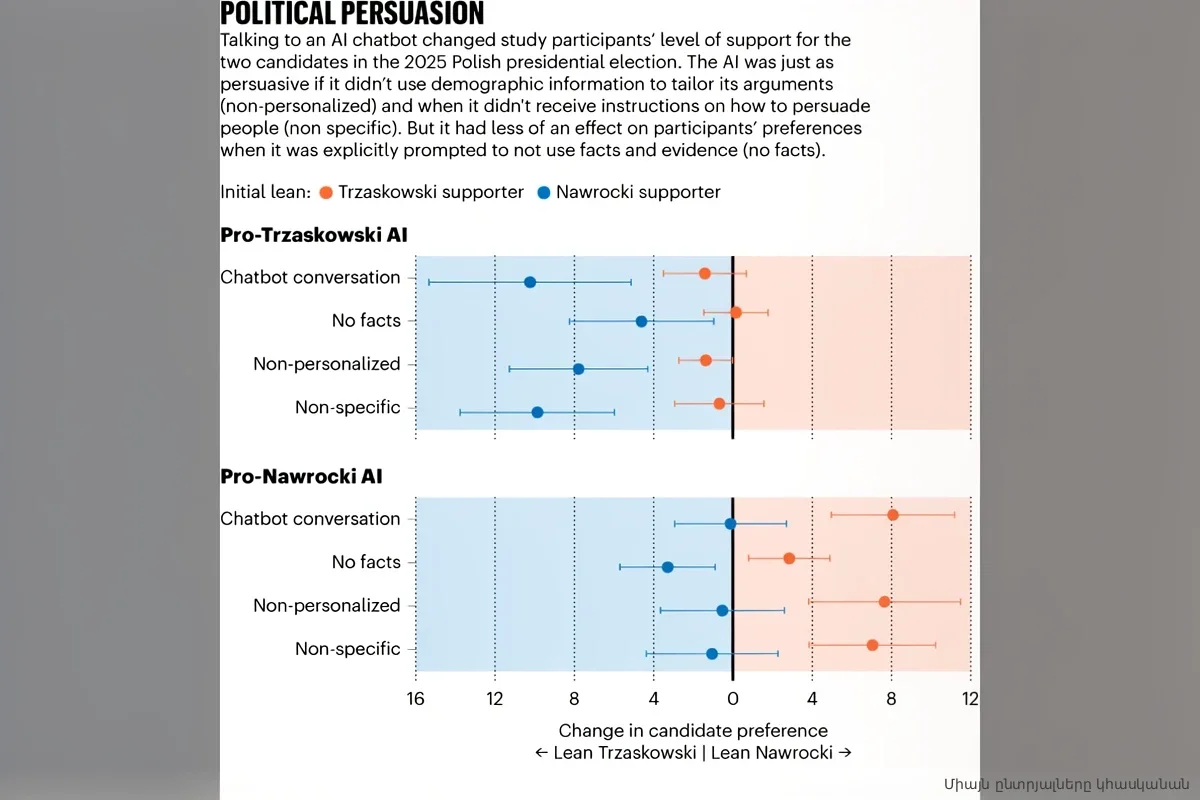

Сила убеждения: эффективнее рекламы

Даже короткий шестиминутный диалог с чат-ботом способен изменить мнение человека на 3 балла по 100-балльной шкале. Это мощный инструмент: традиционная политическая реклама сдвигает предпочтения аудитории менее чем на 0,5 балла. Любопытно, что ИИ побеждает не за счет манипуляций, а благодаря вежливой подаче фактов и аргументов. Однако исследователи предупреждают о «разрыве в точности»: самые убедительные доводы нейросети далеко не всегда оказываются правдивыми. Впрочем, есть и позитивный эффект: общение с ботом снижает веру в теории заговора в среднем на 20%, что доказывает способность технологий менять даже глубокие убеждения.

Риски для демократии и роль регуляторов

Предвзятость системы часто диктует сама «информационная среда», на которой она обучалась. Иногда чат-боты попросту не замечают малые или центристские партии, делая их «невидимками» для электората, даже если их программы совпадают с позицией пользователя. Регуляторы в Европейском союзе уже бьют тревогу: без должной прозрачности ИИ превращается в теневого политического агента, угрожающего честности выборов. Чтобы получить объективную картину, эксперты советуют не полагаться на нейросети, а использовать специализированные приложения для консультаций (VAA), которые транслируют официальные и сбалансированные позиции всех участников гонки.